· Andreas Schwarz · Automation & Workflows · 10 min read

Deployment & Infrastruktur: Wenn Releases zum Risiko werden

Manuelle Deployment-Prozesse und Infrastrukturverwaltung bremsen Unternehmen aus. Automatisierung durch CI/CD und Infrastructure as Code schafft Geschwindigkeit, Qualität und Kontrolle.

Teaser

Software-Updates dauern Stunden, Serverumgebungen unterscheiden sich zwischen Test und Produktion, und jedes Release bedeutet Nervosität statt Routine. Manuelle Deployment-Prozesse und improvisiert verwaltete Infrastrukturen kosten Unternehmen nicht nur Zeit, sondern auch Geld und Vertrauen. Die Lösung liegt in konsequenter Prozessautomatisierung durch CI/CD-Pipelines und Infrastructure as Code. Dieser Artikel zeigt, wie Sie die Kontrolle über Ihre Software-Auslieferung zurückgewinnen und gleichzeitig Geschwindigkeit sowie Qualität steigern.

Deployment & Infrastruktur: Wenn Software-Releases zum Risiko werden

Das Problem beginnt lange vor dem eigentlichen Release

In vielen Unternehmen ist die Auslieferung von Software-Updates eine Prozedur, die mehr an Krisenmanagement als an Routine erinnert. Entwickler bereiten Änderungen vor, IT-Teams übernehmen manuell das Deployment, und zwischen beiden Welten entstehen Missverständnisse und Verzögerungen. Was auf dem Entwicklungsrechner funktioniert, scheitert auf dem Testserver. Was im Test läuft, verhält sich in der Produktionsumgebung anders. Diese Diskrepanzen entstehen, weil Umgebungen nicht identisch konfiguriert sind und manuelle Prozesse Raum für Abweichungen lassen.

Die Auswirkungen sind gravierend und ziehen sich durch alle Unternehmensbereiche. Software-Releases werden zu riskanten Ereignissen, die oft auf Wochenenden oder Nachtstunden verlegt werden, um im Fehlerfall schnell reagieren zu können. Manuelle Deployments erhöhen die Fehlerquote, weil menschliche Eingriffe anfällig für Übersehen, Verwechslung oder Zeitdruck sind. Ein falsch gesetzter Parameter, eine vergessene Konfigurationsdatei oder eine nicht aktualisierte Abhängigkeit kann stundenlange Ausfälle verursachen.

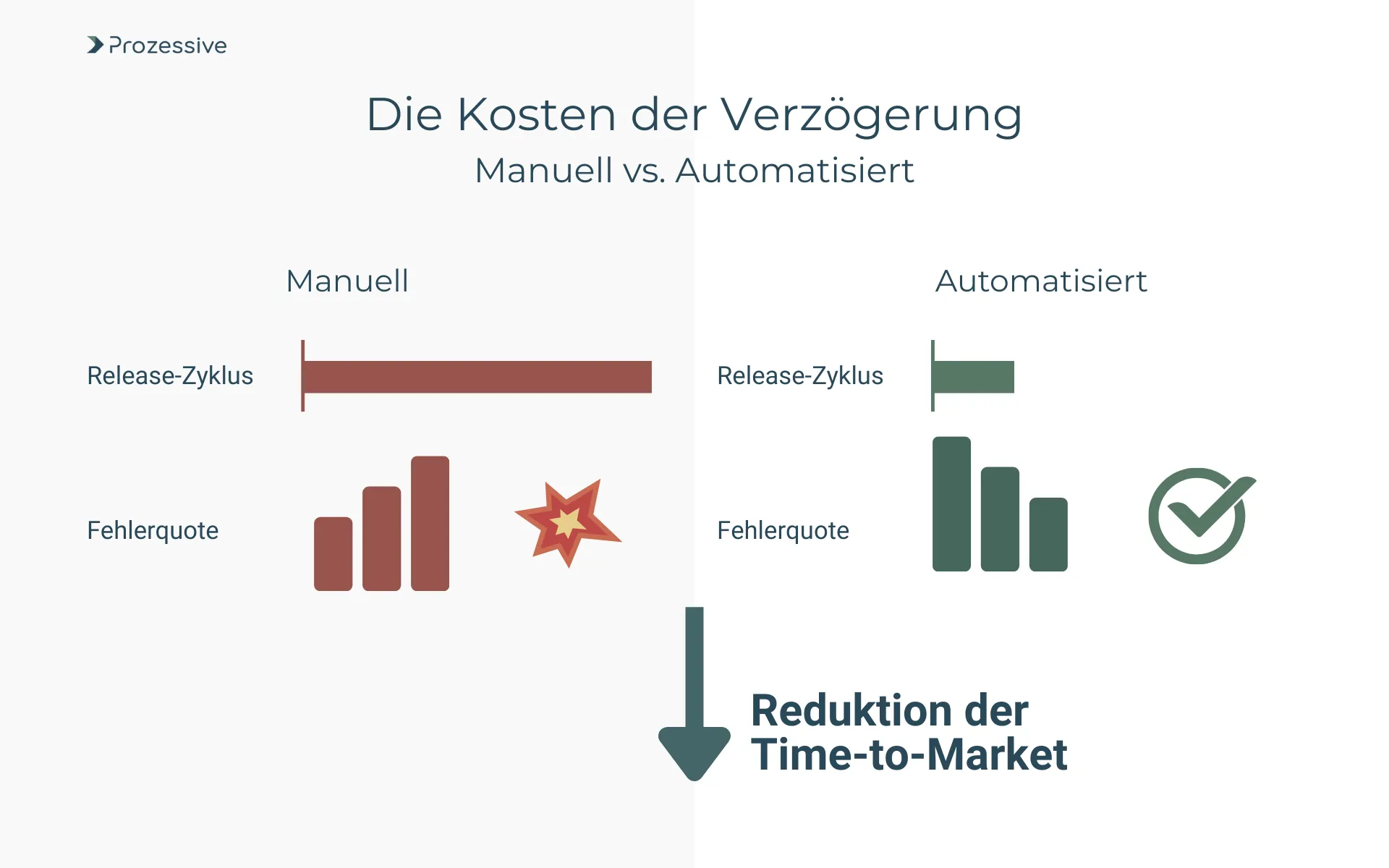

Die wirtschaftliche Dimension dieses Problems wird oft unterschätzt. Eine Studie von Puppet aus 2024 zeigte, dass Unternehmen mit manuellen Deployment-Prozessen durchschnittlich 46 Prozent längere Release-Zyklen haben als solche mit automatisierten Pipelines. Bei durchschnittlich zwölf Major-Releases pro Jahr und einer angenommenen Verzögerung von drei Tagen pro Release entstehen allein durch verlängerte Time-to-Market erhebliche Opportunitätskosten. Hinzu kommen direkte Kosten durch fehlerbedingte Nacharbeiten und Produktivitätsverluste.

Jenseits der messbaren Faktoren entstehen kulturelle Probleme. Entwicklungsteams verlieren die Motivation, wenn ihre Arbeit in langwierigen, fehleranfälligen Deployment-Prozessen stecken bleibt. Das Vertrauen zwischen Entwicklung und Betrieb schwindet, wenn jede Übergabe zu einem potenziellen Konfliktpunkt wird. Die Angst vor Fehlern führt dazu, dass Änderungen zurückgehalten werden, Innovation gebremst wird und technische Schulden wachsen. Dieser Teufelskreis lässt sich nur durch systematische Automatisierung durchbrechen.

Wenn der Alltag zum Hindernislauf wird

Ein mittelständisches Softwareunternehmen mit 120 Mitarbeitern entwickelt eine Cloud-basierte Anwendung für Kundenverwaltung. Jeden zweiten Freitag steht ein Release an. Der Prozess beginnt am Donnerstagabend, wenn die Entwickler ihre Änderungen in das gemeinsame Repository einspielen. Ein Senior-Entwickler übernimmt die Zusammenführung, erstellt manuell ein Installationspaket und übergibt es per E-Mail an das Operations-Team. Die IT-Abteilung stoppt die Produktivumgebung gegen 22 Uhr, sichert die Datenbank, spielt das Update ein und hofft, dass alles funktioniert.

In 30 Prozent der Fälle treten Probleme auf. Eine Datenbankskript-Version passt nicht zur Anwendung, eine Umgebungsvariable fehlt, oder eine Abhängigkeit wurde nicht mitgeliefert. Das Team arbeitet bis in die frühen Morgenstunden an der Fehlersuche, während Kunden auf den Service warten müssen. Der monetäre Schaden durch Ausfallzeiten summiert sich, aber gravierender ist der Vertrauensverlust bei Kunden, die auf zuverlässige Verfügbarkeit angewiesen sind. Das Beispiel zeigt exemplarisch, wie manuelle Prozesse selbst bei erfahrenen Teams zu wiederkehrenden Problemen führen.

Ein anderes Szenario betrifft ein Produktionsunternehmen mit eigener IT-Abteilung. Dort werden Serverumgebungen nach Bedarf eingerichtet, dokumentiert in Word-Dokumenten und Wiki-Einträgen. Wenn ein neuer Entwicklungsserver benötigt wird, dauert die Bereitstellung mehrere Tage. Ein IT-Administrator muss manuell eine virtuelle Maschine erstellen, Betriebssystem und Software installieren, Konfigurationsdateien anpassen und Netzwerkeinstellungen vornehmen. Jede Umgebung unterscheidet sich leicht von den anderen, weil verschiedene Personen unterschiedliche Vorgehensweisen haben oder dokumentierte Schritte veraltet sind.

Diese Varianz führt zu schwer nachvollziehbaren Fehlern. Eine Anwendung verhält sich auf einem Server anders als auf einem anderen, weil Softwareversionen, Bibliotheken oder Systemeinstellungen differieren. Die Fehlersuche wird zum Ratespiel, und Entwickler verschwenden Zeit mit Umgebungsproblemen statt mit Produktentwicklung. Die Abhängigkeit von einzelnen Wissensträgern verschärft das Problem, denn wenn der Administrator im Urlaub oder krank ist, steht die Bereitstellung still. Solche Engpässe sind typisch für Unternehmen, die Infrastruktur als manuellen Prozess verstehen statt als automatisierbare Ressource.

Ein drittes Beispiel stammt aus dem Finanzsektor. Eine Bank mit strengen Compliance-Anforderungen muss jeden Software-Deployment-Schritt dokumentieren und nachweisen können. Manuelle Prozesse bedeuten hier nicht nur Ineffizienz, sondern auch Compliance-Risiken. Wenn ein Deployment händisch durchgeführt wird, fehlt die lückenlose Nachvollziehbarkeit. Wer hat wann welche Änderung vorgenommen? Wurden alle erforderlichen Freigaben eingeholt? Im Audit-Fall kann fehlende Dokumentation zu empfindlichen Strafen führen. Diese Szenarien verdeutlichen, dass manuelle Deployment- und Infrastrukturprozesse nicht nur technische, sondern auch organisatorische und rechtliche Herausforderungen schaffen.

Die Wurzel des Problems liegt in fehlender Standardisierung

Manuelle Prozesse sind von Natur aus anfällig für Varianz. Jeder Eingriff ist eine potenzielle Fehlerquelle, weil Menschen unterschiedlich handeln, Schritte überspringen oder von Dokumentationen abweichen. Wenn zehn IT-Administratoren gebeten werden, einen identischen Server aufzusetzen, entstehen zehn unterschiedliche Konfigurationen. Diese mangelnde Standardisierung ist der Kern des Problems. Ohne einheitliche, wiederholbare Prozesse bleibt Qualität Zufall statt System.

Die fehlende Versionskontrolle für Infrastruktur verschärft die Situation. Während Programmcode längst in Versionskontrollsystemen verwaltet wird, behandeln viele Unternehmen ihre Infrastruktur immer noch als etwas, das irgendwie da ist. Änderungen an Serverkonfigurationen, Netzwerkeinstellungen oder Sicherheitsregeln werden adhoc vorgenommen, ohne dokumentierte Historie. Wenn Probleme auftreten, ist unklar, welche Änderung die Ursache war. Rollbacks sind schwierig oder unmöglich, weil kein definierter Ausgangszustand existiert.

Die Trennung zwischen Entwicklung und Betrieb verstärkt das Problem strukturell. Traditionell werfen Entwickler ihre Software über den Zaun zum Operations-Team, das für den Betrieb verantwortlich ist. Diese Silobildung führt zu Kommunikationsproblemen, weil unterschiedliche Ziele und Anreize existieren. Entwickler wollen schnelle Releases und neue Features, Operations-Teams wollen Stabilität und geringe Änderungsfrequenz. Ohne gemeinsame Verantwortung und Prozesse entsteht ein Spannungsfeld, das Innovation behindert und Fehlerquoten erhöht.

Die mangelnde Testbarkeit manueller Prozesse ist ein weiterer kritischer Faktor. Wenn Deployments händisch durchgeführt werden, können sie nicht automatisiert getestet werden. Es ist unmöglich, hundert Test-Deployments durchzuführen, um Edge Cases zu identifizieren. Das erste echte Deployment ist gleichzeitig der Test, und Fehler zeigen sich erst in der Produktion. Diese Praxis widerspricht grundlegenden Qualitätsprinzipien und führt zwangsläufig zu höheren Fehlerraten. Die Lösung liegt in der konsequenten Automatisierung und Integration von Deployment-Prozessen und Infrastrukturverwaltung.

Automatisierung als Schlüssel zur Kontrolle

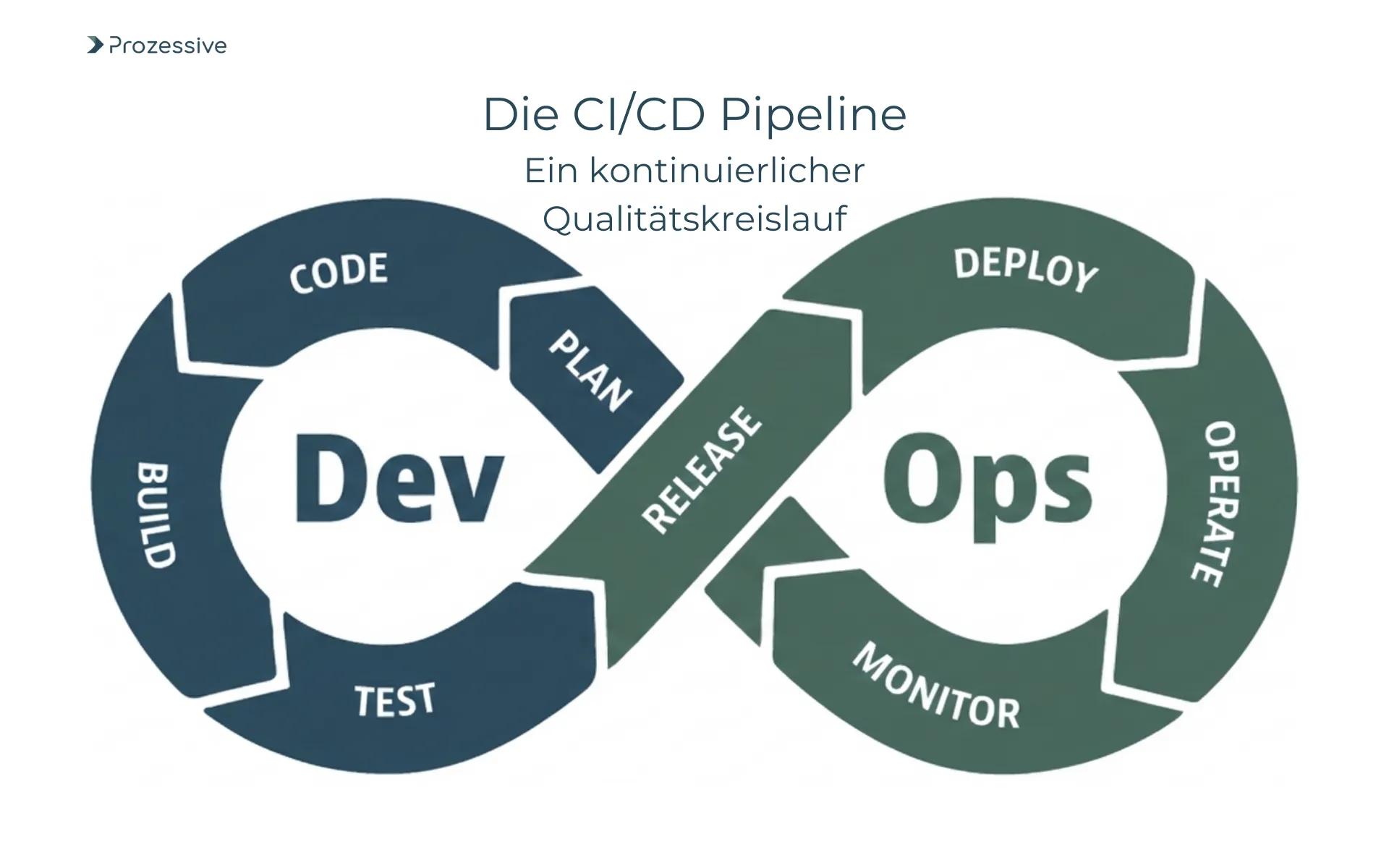

Die Antwort auf diese Herausforderungen liegt in zwei miteinander verbundenen Konzepten: CI/CD-Pipelines (Continuous Integration/Continuous Deployment) und Infrastructure as Code (IaC). Beide Ansätze transformieren manuelle, fehleranfällige Prozesse in automatisierte, wiederholbare Workflows. Sie bilden das Fundament moderner Softwareentwicklung und -auslieferung.

CI/CD-Pipelines automatisieren den gesamten Weg von der Code-Änderung bis zur Produktionsumgebung. Continuous Integration bedeutet, dass Entwickler ihre Änderungen regelmäßig in ein gemeinsames Repository einspielen, wo automatische Tests die Qualität prüfen. Jeder Commit triggert eine Pipeline, die den Code kompiliert, Unit-Tests ausführt, Integrationstests durchführt und bei Erfolg ein Deployment-Artefakt erstellt. Continuous Deployment geht einen Schritt weiter und spielt erfolgreiche Builds automatisch in Testumgebungen und schließlich in die Produktion aus.

Der Wert dieser Automatisierung liegt in der Geschwindigkeit und Zuverlässigkeit. Wo früher Tage oder Wochen zwischen Code-Änderung und Produktiveinsatz lagen, sind es jetzt Minuten oder Stunden. Die Fehlerrate sinkt dramatisch, weil jeder Schritt standardisiert und getestet ist. Rollbacks werden trivial, weil jede Version dokumentiert und reproduzierbar ist.

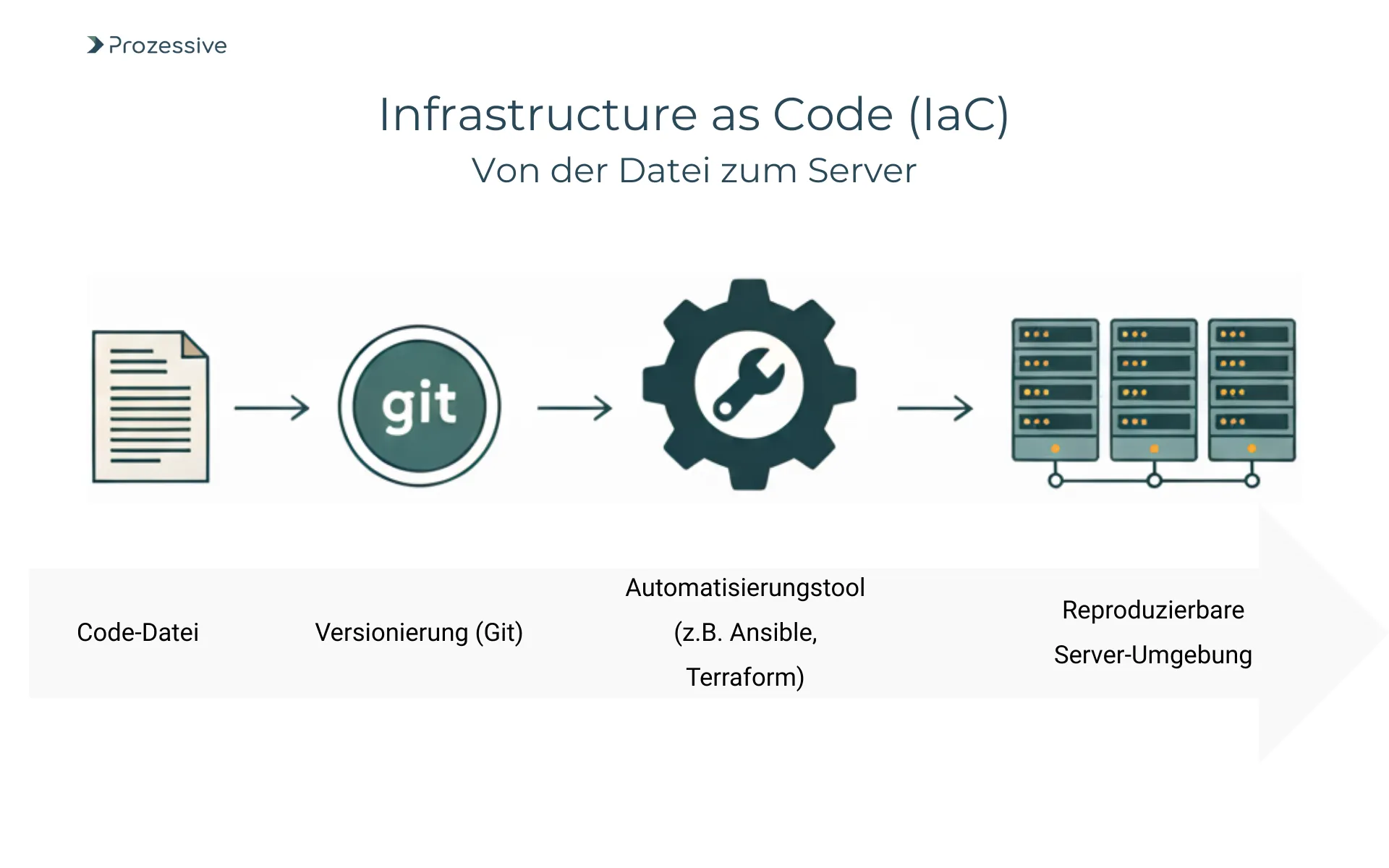

Infrastructure as Code behandelt Serverumgebungen, Netzwerkkonfigurationen und Systemeinstellungen als Code, der in Versionskontrollsystemen verwaltet wird. Statt Server manuell zu konfigurieren, schreiben Teams Deklarationen, die den gewünschten Zustand beschreiben. Tools wie Terraform, Ansible oder CloudFormation lesen diese Deklarationen und erstellen oder aktualisieren die Infrastruktur automatisch. Eine Serverumgebung wird nicht mehr aufgebaut, sondern ausgeführt - reproduzierbar, versioniert und testbar.

Dieser Ansatz löst fundamentale Probleme der manuellen Infrastrukturverwaltung. Umgebungen werden identisch, weil sie aus derselben Code-Basis erstellt werden. Änderungen sind nachvollziehbar, weil sie als Code-Commits dokumentiert sind. Rollbacks sind möglich, weil frühere Versionen jederzeit wiederhergestellt werden können. Die Bereitstellung neuer Umgebungen dauert Minuten statt Tage, weil keine manuelle Arbeit erforderlich ist. Teams gewinnen die Fähigkeit, Infrastruktur zu skalieren, zu experimentieren und schnell auf Anforderungen zu reagieren.

Die Kombination von CI/CD und IaC schafft einen durchgängigen, automatisierten Workflow von der Entwicklung bis zum Betrieb. Code-Änderungen durchlaufen automatische Tests, werden in definierten Infrastrukturen ausgerollt und kontinuierlich überwacht. Probleme werden früh erkannt und schnell behoben. Die Trennung zwischen Entwicklung und Betrieb löst sich auf, weil beide Bereiche gemeinsam an automatisierten Prozessen arbeiten. Diese Kultur der gemeinsamen Verantwortung wird als DevOps bezeichnet und ist mehr als nur ein technisches Konzept, sie ist ein organisatorischer Wandel.

Wichtig ist zu verstehen, dass Automatisierung nicht bedeutet, dass menschliches Eingreifen völlig verschwindet. Vielmehr verlagert sich der Fokus von repetitiven, fehleranfälligen Aufgaben zu strategischen, wertschöpfenden Tätigkeiten. Teams konzentrieren sich auf das Design von Pipelines, die Optimierung von Prozessen und die kontinuierliche Verbesserung. Die eingesparte Zeit durch Deployment und Infrastruktur-Automatisierung fließt in Innovation und Qualitätssteigerung.

Der Weg zur Automatisierung beginnt mit Analyse und Priorisierung

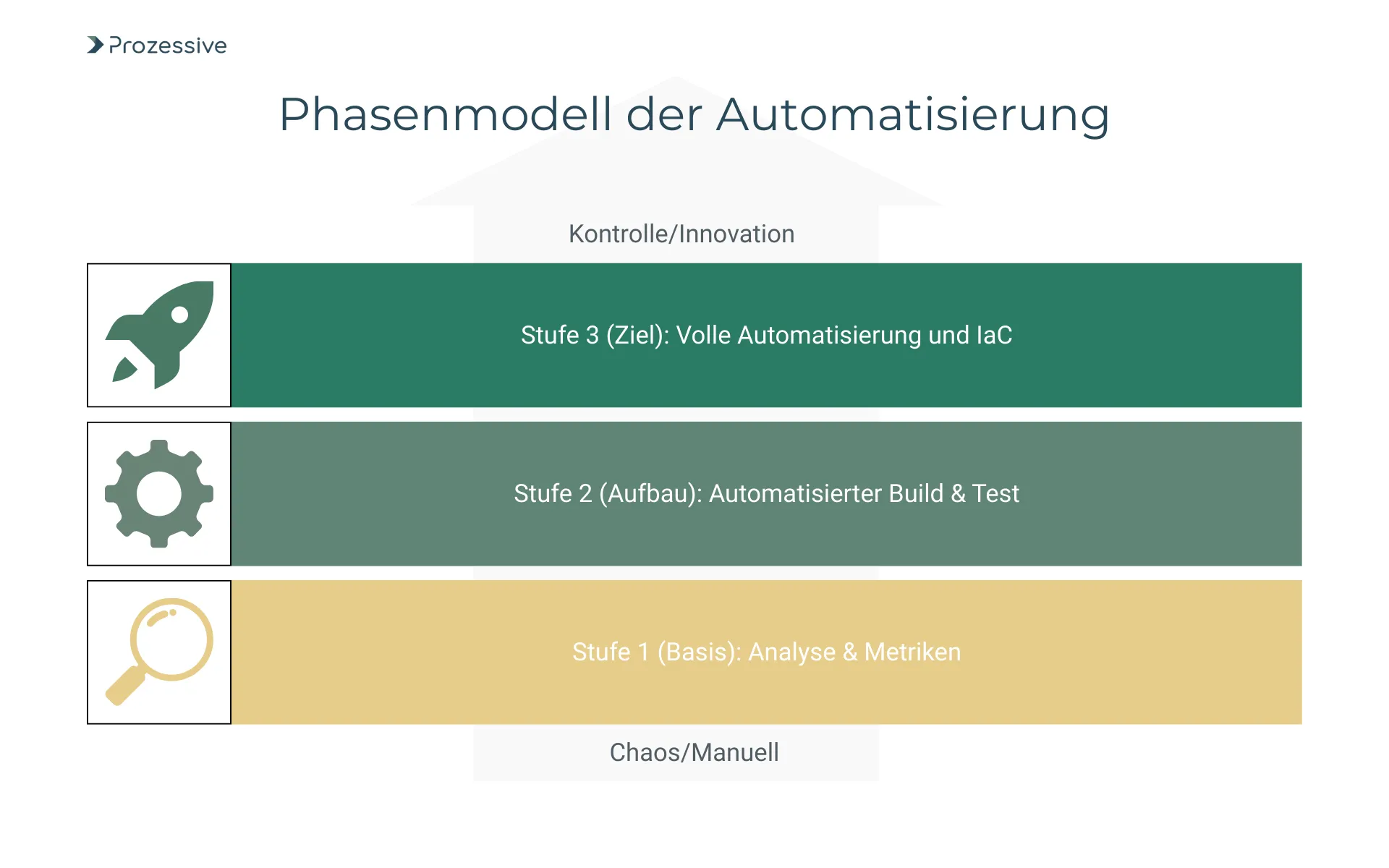

Der Einstieg in automatisierte Deployment- und Infrastrukturprozesse muss nicht mit einem kompletten Umbau beginnen. Erfolgreiche Transformationen folgen einem schrittweisen Ansatz, der mit der Analyse des Status Quo startet. Dokumentieren Sie zunächst Ihre aktuellen Prozesse detailliert. Wie lange dauert ein typisches Deployment? Welche Schritte sind involviert? Wo entstehen Fehler? Welche Abhängigkeiten existieren zwischen Teams?

Diese Bestandsaufnahme schafft Transparenz und identifiziert Schmerzpunkte. Nutzen Sie dabei konkrete Metriken: Deployment-Frequenz, durchschnittliche Deployment-Dauer, Fehlerrate, Time-to-Recovery bei Problemen. Diese Kennzahlen bilden die Referenz, gegen die Sie später Verbesserungen messen können. Beteiligen Sie alle relevanten Stakeholder an dieser Analyse: Entwickler, Operations-Teams, Qualitätssicherung und Business-Verantwortliche. Unterschiedliche Perspektiven decken verschiedene Problembereiche auf.

Priorisieren Sie anschließend die identifizierten Probleme nach Auswirkung und Umsetzbarkeit. Welche manuellen Prozesse verursachen die meisten Fehler? Wo entstehen die größten Verzögerungen? Beginnen Sie mit einem klar abgegrenzten, überschaubaren Bereich. Ein typischer Einstieg ist die Automatisierung des Build-Prozesses: Statt manueller Kompilierung und Paketierung übernimmt eine CI-Pipeline diese Aufgabe automatisch bei jedem Code-Commit. Dieser erste Schritt liefert schnell messbare Ergebnisse und schafft Akzeptanz im Team.

Parallel sollten Sie Infrastruktur-Templates für Standard-Umgebungen entwickeln. Beginnen Sie mit Entwicklungs- oder Testservern, nicht mit der Produktionsumgebung. Definieren Sie den gewünschten Zustand dieser Umgebungen als Code und nutzen Sie IaC-Tools zur automatischen Bereitstellung. Der Lerneffekt ist hoch, das Risiko gering. Teams gewinnen Erfahrung mit neuen Technologien und Arbeitsweisen, ohne kritische Systeme zu gefährden.

Toolauswahl ist wichtig, sollte aber nicht der erste Schritt sein. Verstehen Sie zunächst Ihre Anforderungen und Abhängigkeiten. Arbeiten Sie in der Cloud, on-premise oder hybrid? Welche Programmiersprachen nutzen Sie? Welche Compliance-Anforderungen bestehen? Erst mit diesen Antworten können Sie Tools sinnvoll evaluieren. Vermeiden Sie den Fehler, sich auf einzelne Produkte zu fixieren. Wichtiger als das konkrete Tool ist das Verständnis der zugrundeliegenden Prinzipien und Methoden.

Investieren Sie in Schulung und Know-how-Aufbau. CI/CD und Infrastructure as Code erfordern neue Kompetenzen, die nicht über Nacht entstehen. Externe Expertise kann den Einstieg beschleunigen, sollte aber immer mit dem Ziel verbunden sein, internes Wissen aufzubauen. Pair Programming zwischen erfahrenen externen Beratern und internen Teams ist hier besonders wirksam. Das Ziel ist nicht, Abhängigkeit von Dienstleistern zu schaffen, sondern autonome, handlungsfähige Teams zu entwickeln.

Etablieren Sie eine Kultur der kontinuierlichen Verbesserung. Automatisierung ist kein einmaliges Projekt, sondern ein fortlaufender Prozess. Regelmäßige Retrospektiven helfen, Verbesserungspotenziale zu identifizieren. Messen Sie kontinuierlich die definierten Metriken und feiern Sie Fortschritte. Kleine, inkrementelle Verbesserungen summieren sich über Zeit zu substanziellen Ergebnissen. Die DevOps-Bewegung betont diesen iterativen Ansatz als Kernprinzip erfolgreicher Transformation.

Berücksichtigen Sie auch die menschliche Dimension. Automatisierung wird von manchen als Bedrohung wahrgenommen. Kommunizieren Sie klar, dass das Ziel nicht der Abbau von Arbeitsplätzen ist, sondern die Befreiung von monotonen, fehleranfälligen Aufgaben. Teams, die nicht mehr mit manuellen Deployments kämpfen, haben Zeit für anspruchsvollere, erfüllendere Arbeit. Diese Botschaft muss glaubwürdig vermittelt und durch Taten unterstützt werden.

Fazit: Von der Reaktion zur Kontrolle

Manuelle Deployment- und Infrastrukturprozesse sind mehr als nur ineffizient. Sie sind ein strategisches Hindernis für Unternehmen, die in digitalen Märkten wettbewerbsfähig bleiben wollen. Die systematische Automatisierung durch CI/CD-Pipelines und Infrastructure as Code transformiert Software-Auslieferung von einem risikobehafteten Ereignis zu einer routinierten, kontrollierten Operation. Unternehmen gewinnen Geschwindigkeit, Qualität und die Fähigkeit, schnell auf Marktanforderungen zu reagieren.

Der Einstieg erfordert keine Revolution, sondern einen durchdachten, schrittweisen Ansatz. Beginnen Sie mit der Analyse, identifizieren Sie Schmerzpunkte, priorisieren Sie klar abgrenzbare Bereiche und bauen Sie systematisch Kompetenzen auf. Nutzen Sie erste Erfolge, um Momentum zu erzeugen und weitere Automatisierung voranzutreiben. Die Investition in moderne Deployment- und Infrastrukturprozesse zahlt sich mehrfach aus: In reduzierten Kosten, höherer Qualität und zufriedeneren Teams. Wer heute nicht automatisiert, verliert morgen den Anschluss.